deployement

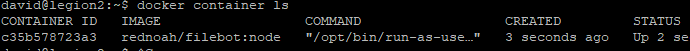

La commande docker avec le filesystem preparé

docker run --rm -it \

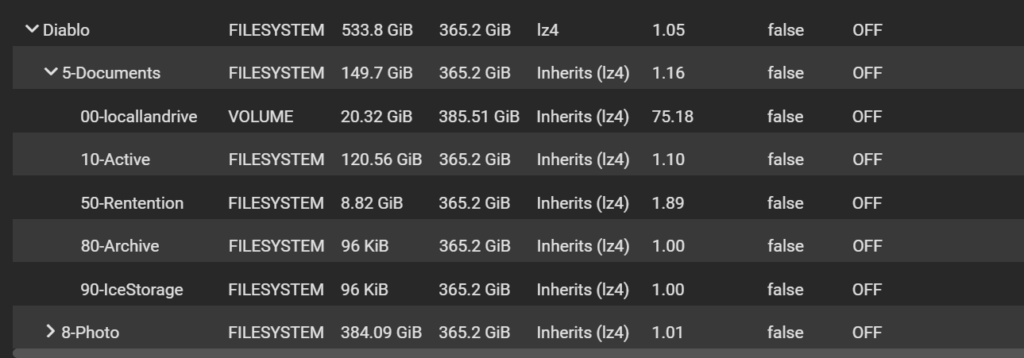

-v /Videoclub:/videoclub \

-v /usr/kubedata/filebot-node/data:/data \

-p 5452:5452 \

maliciamrg/filebot-node-479traduction en kubernetes deploy :

apiVersion: apps/v1

kind: Deployment

metadata:

name: filebot-node

namespace: default

labels:

app: filebot

spec:

replicas: 1

selector:

matchLabels:

app: filebot

template:

metadata:

labels:

run: filebot-node

app: filebot

spec:

containers:

- name: filebot-node

image: maliciamrg/filebot-node-479

ports:

- containerPort: 5452

name: filebot-http

volumeMounts:

- mountPath: /data

name: filebot-data

- mountPath: /videoclub

name: filebot-media

volumes:

- name: filebot-data

hostPath:

type: DirectoryOrCreate

path: /usr/kubedata/filebot-node/data

- name: filebot-media

hostPath:

type: Directory

path: /Videoclub

---

apiVersion: v1

kind: Service

metadata:

name: filebot

spec:

selector:

app: filebot

ports:

- name: "http"

port: 5452

targetPort: 5452

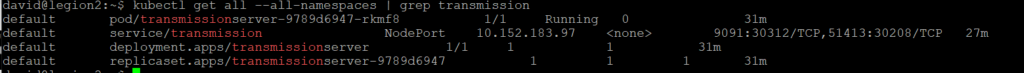

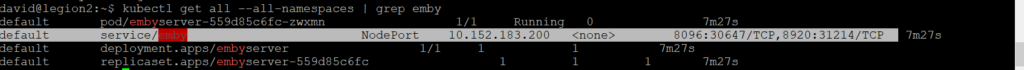

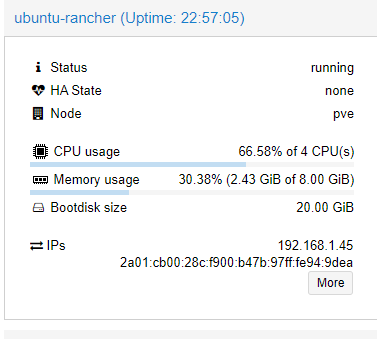

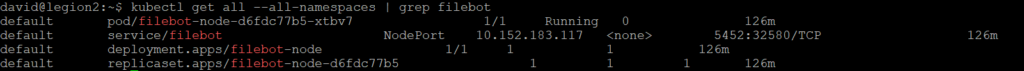

type: NodePortpuis on recupere le recupere le port d’exposition

kubectl get all --all-namespaces | grep filebot

resultat le dashboard est accecible https://<master-ip>:32580